语言模型

一段自然语言文本可以看作是一个离散时间序列,给定一个长度为$T$的词的序列$w_1, w_2, \ldots, w_T$。

语言模型的目标就是评估该序列是否合理,即计算该序列的概率:

$$

P(w_1, w_2, \ldots, w_T).

$$

假设序列$w_1, w_2, \ldots, w_T$中的每个词是依次生成的,则有

$$

\begin{aligned}

P(w_1, w_2, \ldots, w_T)

&= \prod_{t=1}^T P(w_t \mid w_1, \ldots, w_{t-1})\\

&= P(w_1)P(w_2 \mid w_1) \cdots P(w_T \mid w_1w_2\cdots w_{T-1})

\end {aligned}

$$

例如,一段含有4个词的文本序列的概率

$$

P(w_1, w_2, w_3, w_4) = P(w_1) P(w_2 \mid w_1) P(w_3 \mid w_1, w_2) P(w_4 \mid w_1, w_2, w_3).

$$

语言模型的参数就是词的概率以及给定前几个词情况下的条件概率。设训练数据集为一个大型文本语料库,如维基百科的所有条目.

词的概率可以通过该词在训练数据集中的相对词频来计算,例如,$w_1$的概率可以计算为:

$$

\hat P(w_1) = \frac{n(w_1)}{n}

$$

其中$n(w_1)$为语料库中以$w_1$作为第一个词的文本的数量,$n$为语料库中文本的总数量。

类似的,给定$w_1$情况下,$w_2$的条件概率可以计算为:

$$

\hat P(w_2 \mid w_1) = \frac{n(w_1, w_2)}{n(w_1)}

$$

其中$n(w_1, w_2)$为语料库中以$w_1$作为第一个词,$w_2$作为第二个词的文本的数量。

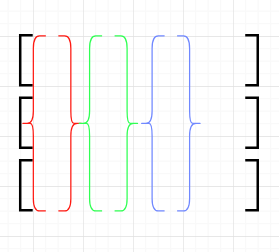

n 元语法

序列长度增加,计算和存储多个词共同出现的概率的复杂度会呈指数级增加。$n$元语法通过马尔可夫假设简化模型,马尔科夫假设是指一个词的出现只与前面$n$个词相关,即$n$阶马尔可夫链(Markov chain of order $n$),如果$n=1$,那么有$P(w_3 \mid w_1, w_2) = P(w_3 \mid w_2)$。基于$n-1$阶马尔可夫链,我们可以将语言模型改写为

$$

P(w_1, w_2, \ldots, w_T) = \prod_{t=1}^T P(w_t \mid w_{t-(n-1)}, \ldots, w_{t-1}) .

$$

以上也叫$n$元语法($n$-grams),它是基于$n - 1$阶马尔可夫链的概率语言模型。例如,当$n=2$时,含有4个词的文本序列的概率就可以改写为:

$$

\begin{aligned}

P(w_1, w_2, w_3, w_4)

&= P(w_1) P(w_2 \mid w_1) P(w_3 \mid w_1, w_2) P(w_4 \mid w_1, w_2, w_3)\\

&= P(w_1) P(w_2 \mid w_1) P(w_3 \mid w_2) P(w_4 \mid w_3)

\end{aligned}

$$

当$n$分别为1、2和3时,我们将其分别称作一元语法(unigram)、二元语法(bigram)和三元语法(trigram)。例如,长度为4的序列$w_1, w_2, w_3, w_4$在一元语法、二元语法和三元语法中的概率分别为

$$

\begin{aligned}

P(w_1, w_2, w_3, w_4) &= P(w_1) P(w_2) P(w_3) P(w_4) ,\\

P(w_1, w_2, w_3, w_4) &= P(w_1) P(w_2 \mid w_1) P(w_3 \mid w_2) P(w_4 \mid w_3) ,\\

P(w_1, w_2, w_3, w_4) &= P(w_1) P(w_2 \mid w_1) P(w_3 \mid w_1, w_2) P(w_4 \mid w_2, w_3) .

\end{aligned}

$$

当$n$较小时,$n$元语法往往并不准确。例如,在一元语法中,由三个词组成的句子“你走先”和“你先走”的概率是一样的。然而,当$n$较大时,$n$元语法需要计算并存储大量的词频和多词相邻频率。

深入理解元语法的缺陷

参数空间过大

n 元语法当 n 足够大的时候词频和使用频率的计算会越来越大

数据稀疏

齐夫定律:按频率递减顺序排列的频率词表中,单词的频率与它的序号之间存在“幂律”(power law)关系,即如果把单词按使用频率排序,那么使用频率与序号之间几乎恰好成反比。

在缺陷的基础上寻找问题的解决办法

数据采样

随机采样 && 相邻采样

引入数据集

利用周杰伦的歌词作为数据集 jaychou_lyrics.txt

1 | # read data |

数据采样

在训练中我们需要每次随机读取小批量样本和标签。时序数据的一个样本通常包含连续的字符。假设时间步数为5,样本序列为5个字符,即“想”“要”“有”“直”“升”。该样本的标签序列为这些字符分别在训练集中的下一个字符,即“要”“有”“直”“升”“机”,即$X$=“想要有直升”,$Y$=“要有直升机”。

现在我们考虑序列“想要有直升机,想要和你飞到宇宙去”,如果时间步数为5,有以下可能的样本和标签:

- $X$:“想要有直升”,$Y$:“要有直升机”

- $X$:“要有直升机”,$Y$:“有直升机,”

- $X$:“有直升机,”,$Y$:“直升机,想”

- …

- $X$:“要和你飞到”,$Y$:“和你飞到宇”

- $X$:“和你飞到宇”,$Y$:“你飞到宇宙”

- $X$:“你飞到宇宙”,$Y$:“飞到宇宙去”

可以看到,如果序列的长度为$T$,时间步数为$n$,那么一共有$T-n$个合法的样本,但是这些样本有大量的重合,我们通常采用更加高效的采样方式。我们有两种方式对时序数据进行采样,分别是随机采样和相邻采样。

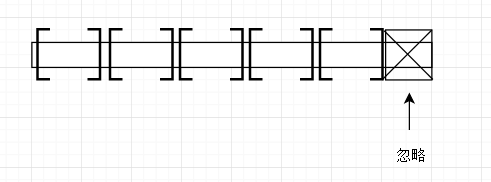

随机采样

下面的代码每次从数据里随机采样一个小批量。其中批量大小batch_size是每个小批量的样本数,num_steps是每个样本所包含的时间步数。

在随机采样中,每个样本是原始序列上任意截取的一段序列,相邻的两个随机小批量在原始序列上的位置不一定相毗邻。

1 | import torch |

测试

1 | my_seq = list(range(30)) |

1 | Result: |

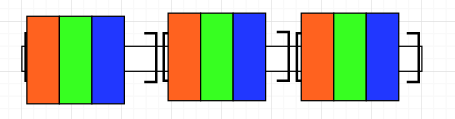

相邻采样

在相邻采样中,相邻的两个随机小批量在原始序列上的位置相毗邻。

三部分堆叠构成二维的 tensor

1 | def data_iter_consecutive(corpus_indices, batch_size, num_steps, device=None): |

测试

1 | for X, Y in data_iter_consecutive(my_seq, batch_size=2, num_steps=6): |

1 | Result: |